Pflichtethik für Programmierer: Ein Physiker forscht, wie sich das Internet verändern muss

Der Physiker Dr. Philipp Lorenz-Spreen hat soziale Netzwerke zum Zentrum seiner Forschung gemacht. Er untersucht, wie sich dort Meinungen entwickeln und nutzt Verhaltensexperimente, um zu verstehen, welchen Einfluss Veränderungen der Online-Umgebung auf das Verhalten der User*innen haben. Mit Qiio spricht er darüber, wie Pro-Social Design das Netz zu einem demokratischen Ort machen kann.

Philipp Lorenz-Spreen erforscht Sozialphysik, soziale Netzwerke und Meinungsdynamik. Foto: Dr. Philipp Lorenz-Spreen.

Philipp, du bist Physiker und arbeitest als Postdoc am Max-Planck-Institut für Bildungsforschung in Berlin. Dort forschst du zu sozialen Netzwerken, kollektiver Aufmerksamkeit und Demokratie im Internet. Was hat das mit Physik zu tun?

Es gibt einen kleinen Bereich in der Physik, den man komplexe Systeme nennt. Damit sind alle Systeme gemeint, die aus einfachen Bausteinen bestehen, die aber zu etwas Komplexerem werden, wenn man sie zusammenschaltet. Das ist zum Beispiel bei einem Ameisenhaufen so. Die einzelne Ameise hat wenige Regeln, denen sie folgt, aber zusammen kann das Kollektiv, also das Ameisenvolk, komplizierte Aufgaben lösen. Und so kann man auch soziale Netzwerke betrachten, wobei hier die Einzelbausteine deutlich komplexer sind. So bin ich als Physiker zu sozialen Netzwerken gekommen. Dann fängt man an, darüber nachzudenken, wie wir uns kollektiv im Internet verhalten und wie dort Meinung gebildet wird. Und dann ist man auch nicht mehr weit weg vom Thema Demokratie.

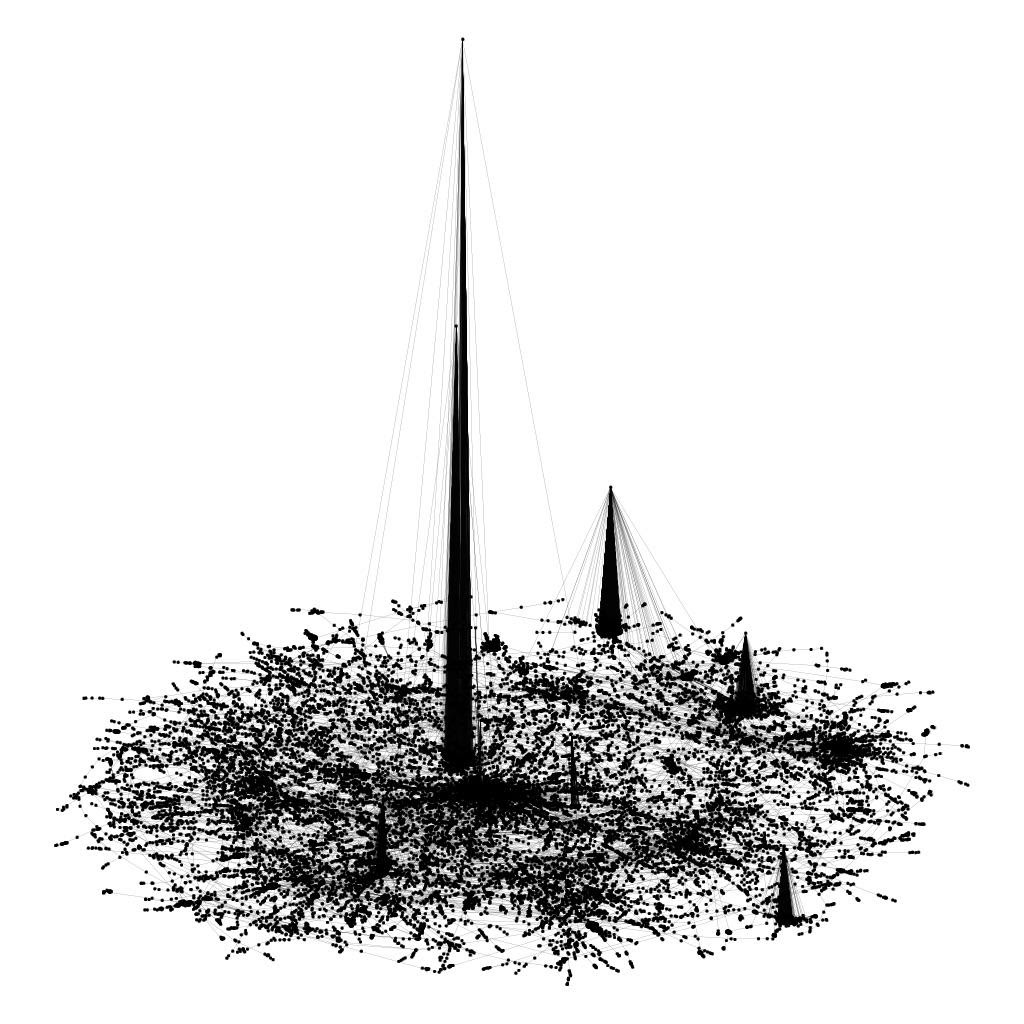

Twitter Accounts (Punkte) und Retweets (Linien): Die aktivsten Accounts (an der Höhe erkennbar) sind oft zentral im Netzwerk verortet und können dadurch viele andere Nutzer erreichen (vgl. Influencer). Abbildung: Lorenz-Spreen.

Dein gerade erschienenes Paper im Nature Journal trägt den Titel „How behavioural sciences can promote truth, autonomy and democratic discourse online“. War deine Haupterkenntnis, dass das Internet Wahrheit, Autonomie und demokratischen Diskurs nicht fördert?

Das könnte man so interpretieren. Für viele Menschen besteht das Internet vor allem aus großen Suchmaschinen und sozialen Plattformen, in deren Agenda diese Werte, also Wahrheit, Autonomie und demokratischer Diskurs, nicht unbedingt eingeflochten sind. Gleichzeitig finden aber große Teile der demokratischen Meinungsbildung und des öffentlichen Diskurses auf diesen Plattformen statt. Als diese noch kleiner waren, ging es mehr darum, Fotos zu teilen und Likes zu bekommen. Mittlerweile werden dort wichtige gesellschaftliche Themen diskutiert, wie an den Tweets der Politiker*innen in den USA deutlich wird. Das ist die Diskrepanz, die wir beleuchten.

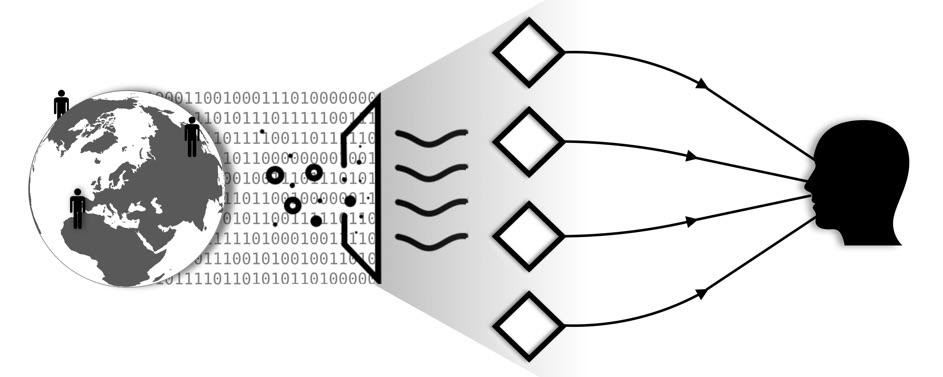

Schematische Darstellung eines Entscheidungsmodells, in dem der Nutzer (rechts) die Online-Welt über bestimmte Signale („cues”, dt. Rauten) wahrnimmt, die von Internetdienstleistern bereitgestellt werden. Foto: Lorenz-Spreen.

Wie können wir denn mehr Autonomie und Wahrheit im Netz erlangen?

Wir überlegen uns dazu, wie sich die Entscheidungsumgebung für jede*n Einzelne*n verbessern kann. Mit der Entscheidungsumgebung meinen wir die Summe aller Faktoren, die man auf dem Bildschirm aufnehmen kann und die dazu führt, dass man eine Entscheidung trifft. Das kann bedeuten, etwas zu glauben, etwas zu teilen oder seine Meinung zu ändern. Das soziale Netzwerk ist dabei wichtig, um Informationen einzuordnen.

Befasst ihr euch auch mit den sozialen Blasen, in denen sich Menschen im Netz bewegen?

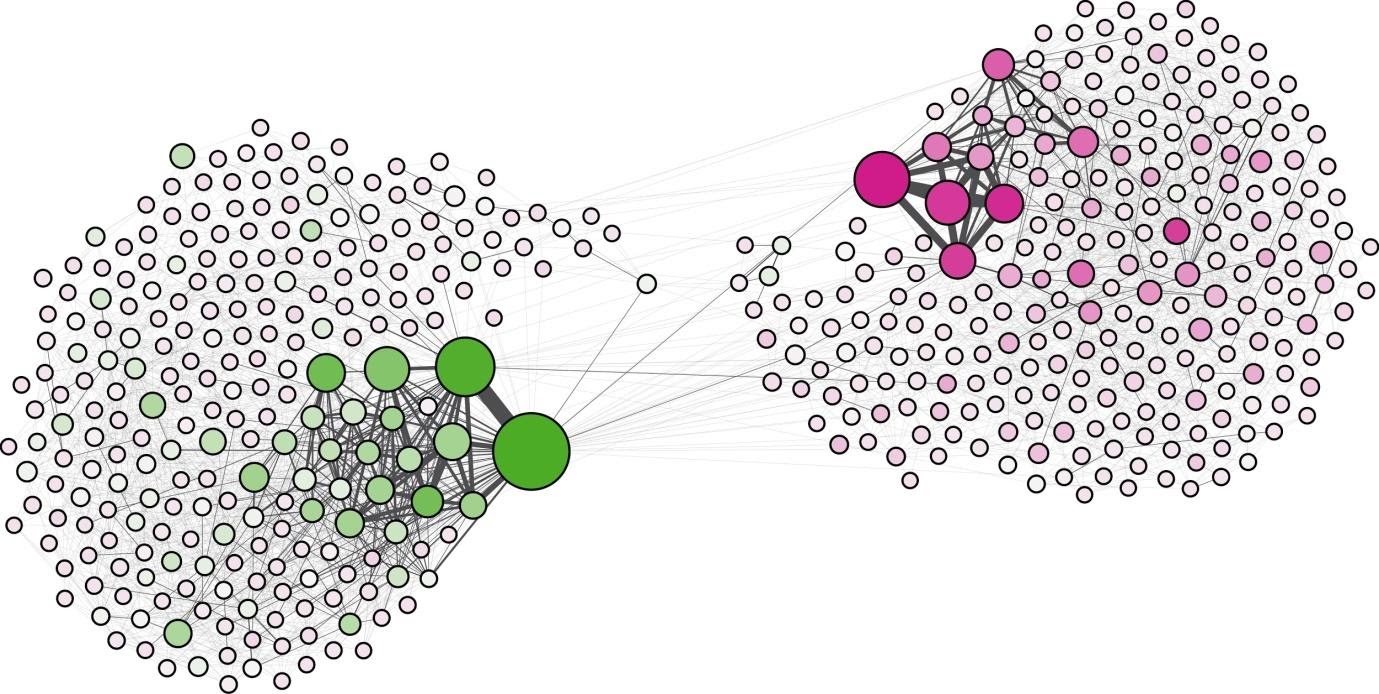

In sozialen Netzwerken sieht man nur die Inhalte der Menschen, mit denen man verknüpft ist. Und das kann dazu führen, dass sich manche Leute in der Mehrheit fühlen, obwohl sie es nicht sind. Dazu kommt auch, dass die großen Zahlen auf sozialen Plattformen für uns schwierig zu verstehen sind. Wenn auf Facebook eintausend Leute meine Meinung teilen, erscheint das vielleicht viel, aber verglichen mit drei Milliarden User*innen ist diese Zahl dann gar nicht so groß. Dafür fehlt uns oft das Gefühl und von sozialen Plattformen gibt es keine Hilfestellungen, diese Zahlen realistisch einzuschätzen. Ihr Ziel ist es, dass man sich möglichst wohlfühlt, nicht, dass man einen möglichst guten Überblick hat.

Visualisierung eines sozialen Netzwerks, das sich in zwei polarisierte Gruppen einteilt. Abbildung: Lorenz-Spreen

Also bräuchte man mehr Transparenz, um zu verstehen, welche Inhalte man angezeigt bekommt?

Wir argumentieren sehr stark in diese Richtung. Zu viel Information kann natürlich auch eine Art Totschlagwirkung haben, so argumentieren Facebook und andere. Aber so ganz bin ich davon nicht überzeugt. Wir setzen auf Transparenz, weil wir argumentieren, dass die Leute dazu in der Lage sind, sich damit auseinanderzusetzen, wie sich der eigene News-Feed zusammensetzt, woher die Posts kommen und wie weit sie verbreitet sind. Wichtige Voraussetzung ist, dass die Informationen gut dargestellt werden.

Wie wäre es mit einer Art Ampelsystem für Netzinhalte?

Da wäre ich vorsichtig. Das würde diejenigen in eine Machtposition bringen, die diese Ampel machen und darüber entscheiden, was die Wahrheit ist und was nicht. Ich wäre dafür, dass man Labels einführt, die klarer kategorisieren, welche Art von Inhalt man gerade sieht. Also Labels, die Kontext geben, zum Beispiel durch einfache Symbole für News, Content von deinen Freunden, Aussagen von Prominenten usw. Dann kann man sich selbst ein Bild machen und ein Urteil fällen. Ich würde ungern sehen, dass Twitter oder Facebook die Grenzen ziehen und sagen: „Ab hier markieren wir Falschmeldungen und ab da nicht.“

Momentan entscheiden die großen Plattformen über den Inhalt, man spricht auch von Content Curation. Wer könnte denn Interesse daran haben, die Ansätze der Forschung weiterzuentwickeln?

(Lacht) Das wird noch spannend. Ich bin überzeugt davon, dass die Details in der Benutzeroberfläche und im Design wirklich wichtig sind. Wenn man sagt: „Man muss soziale Medien regulieren“, kommt man leider an seine Grenzen. Beim Essen wissen wir, dass es Vorgaben für die Inhaltsangaben gibt. Bei sozialen Plattformen kann man nicht jedes Designelement, jedes Stückchen an Informationen durchregulieren. Da muss man schon drauf hoffen, dass die Plattformen die Ansätze unserer Forschung aufnehmen. Durch ein Bewusstsein in der Bevölkerung könnte Transparenz zu einem Qualitätsmerkmal einer Plattform werden. Ein bisschen wie bei Bio-Nahrungsmitteln, deren Labels ein Erkennungsmerkmal sind. Irgendwann könnte eine soziale Plattform dadurch herausstechen, dass sie transparente Informationen anzeigt oder den Newsfeed so gestaltet, dass man ihn selbst verändern kann.

Und das gibt es bisher noch nicht?

Es gibt einige Start-ups und kleine Versuche, um prosoziale Netzwerke zu bauen, aber bis jetzt kommt man noch nicht an die großen Plattformen heran. Es gibt schon Ansätze, wie Browser Add-Ons, die dabei helfen sollen, Kontext zu geben. Das Browser-Plugin „Newsguard“ ist eine Ampel mit grünem Häkchen für vertrauenswürdige Quellen. Das ist schon recht transparent gemacht. Aber das geht mir noch nicht weit genug. Wenn mal eine vertrauenswürdige Quelle einen falschen Artikel schreibt, würde man das damit nicht abfangen können. Noch ein Beispiel ist „WhoTargets Me“: ein Add-on, das dir sagt, welche politischen Parteien dich auf Facebook durch Werbung angesprochen haben.

Muss eine Sensibilisierung nicht auch außerhalb des Internets stattfinden?

Man sollte die Schulbildung auf keinen Fall ausklammern. Aber wenn die Online-Umgebung, in der man sich bewegt, dagegen arbeitet, dann wird es schwierig bleiben. Wenn mir mein Feed dann immer noch den reißerischsten Artikel ganz oben anzeigt, dann ist es sehr mühsam. Das hat alles seine Parallelen, sehen wir uns doch einmal das Beispiel der Ernährung an: Wenn man sich vornimmt, sich etwas regionaler ernähren oder weniger Fleisch konsumieren zu wolllen, dann ist es in einem großen Supermarkt nicht gar nicht so einfach, dem Junk-Food zu entgehen, weil dies einem sehr stark präsentiert wird. In einem Umfeld, wo das alles etwas einfacher geht, braucht man auch nicht ganz so viel persönliche Sensibilisierung und muss nicht alles doppelt checken.

Hat das damit zu tun, wie sich das Internet bisher entwickelt hat?

Auf jeden Fall. Große Plattformen basieren auf Werbung und die Möglichkeit, diese zu verkaufen und Nutzer*innen damit zu erreichen. Dass mittlerweile ein Teil unserer Öffentlichkeit auf diesem Geschäftsmodell basiert, ist problematisch. Das Geschäftsmodell würden wir sogar als den ursprünglichen Grund für den Mangel an Transparenz und Autonomie der User*innen ausmachen. Das kann man nicht mal eben umstülpen, denn das ist eine riesige Industrie. Aber es ist wichtig zu verstehen, dass die aufmerksamkeitsheischende Industrie dahinter steht, dass zum Beispiel Qualität keine große Rolle spielt. So kann man für die Zukunft lernen.

Ihr schlagt Interventionen vor, die User*innen in die Lage zu versetzen, informierte und autonome Entscheidungen im Online-Ökosystem zu treffen, u.a. durch Nudging und Boosting. Welche ganz konkreten Maßnahmen sind notwendig, damit die Forschungsergebnisse Umsetzung finden?

Nudging und Boosting sind verhaltenswissenschaftliche Maßnahmen. Man versucht beim Nudging, das menschliche Verhalten durch kleine Veränderungen in der Umgebung zu lenken, z.B. dahingehend, weniger Falschnachrichten zu teilen. Um solche Maßnahmen unabhängig entwerfen und testen zu können, muss die Forschung mehr Zugang zu den Daten der Plattformen bekommen. Man kann relativ sicher davon ausgehen, dass ein paar Transparenzmaßnahmen auf den jeweiligen Plattformen den Benutzer*innen nicht schaden würden. Die Anzahl der Likes in Relation zu den Leuten anzuzeigen, die einen Artikel gesehen haben, wäre ein Schritt, den man schon mal ausprobieren könnte, um mehr Transparenz zu schaffen.

Muss Design dabei noch sehr viel mehr in die Verantwortung genommen werden? Ich meine damit, dass auch die Menschen, die das Erscheinungsbild im Internet gestalten, speziell ausgebildet werden müssen?

Ich hatte in der letzten Zeit vermehrt Kontakt zu Designer*innen, die sagen, sie wollen mehr Verantwortung übernehmen und Pro-Social Design im Netz etablieren. Da tut sich gerade viel. Es gibt auch mehr Bestrebungen, Ethikkurse im Informatikstudium anzubieten. Bis vor Kurzem hatten die Technikentwicklung und das Design sehr wenig mit Soziologie, Psychologie, Ethik oder überhaupt mit der Gesellschaft zu tun. Aber mittlerweile wird es immer wichtiger zu verstehen, wie Technik und Mensch zusammen funktionieren. Bis jetzt sind die Plattformen vor allem gut darin gewesen, unsere Aufmerksamkeit auf Werbung zu lenken. Jetzt sollte man sich überlegen, was man noch tun kann, außer alles dem Werbebusiness zu überlassen.

Muss sich das Internet also grundlegend verändern?

Es gab eine Euphorie, dass durch das Internet alles demokratischer wird, alle sich vernetzen und man gar keine Regeln braucht. Das war ein schöner Gedanke, es kamen dann aber doch die großen Plattformen, die viel übernommen haben, und jetzt ist man zehn Jahre in dieser Entwicklung drin und merkt, dass es zumindest nicht dazu geführt hat, dass wir als Gesellschaft total zusammengewachsen sind und dass alles nur positive Auswirkungen hat. Nach zehn Jahren existieren viele Probleme weiter und werden sich nicht von selbst lösen. In Deutschland gibt es immer mehr Gesetzesentwürfe und Gesetze, auf EU-Ebene wird ebenfalls viel gemacht, um da Ordnung reinzubringen, das ist auch notwendig. Deswegen glaube ich, dass wir an einem Punkt sind, an dem sich einiges ändern wird. Ich bin gespannt, wie lange es Facebook geben wird, ob etwas anderes an diese Stelle tritt oder eben nicht, und wie sich die Plattformen verändern.

Meine letzte Frage: Wie sieht deine Vision eines idealen Internets aus?

Idealerweise können wir Wissenschaftler dazu beitragen. Ich stelle mir vor, dass es Standards gibt, die alle einhalten, weil man herausgefunden hat, dass sie zu Kooperation und zu konstruktiven Diskursen führen. Das sind vielleicht Designelemente oder strukturelle Elemente, die sich als Standards etabliert haben oder als solche festgelegt sind. Ich stelle mir vor, dass es dann Räume gibt, wo ein ausbalancierter und ziviler Diskurs über wirklich wichtige gesellschaftliche Probleme stattfindet. Vielleicht gibt es auch EU-weite Plattformen, die unabhängig und somit nicht auf Werbeeinnahmen angewiesen sind. Ähnlich wie der öffentlich-rechtliche Rundfunk funktioniert, könnte es Plattformen geben, die mit einer anderen Zielfunktion gebaut werden.

Danke für das Gespräch!